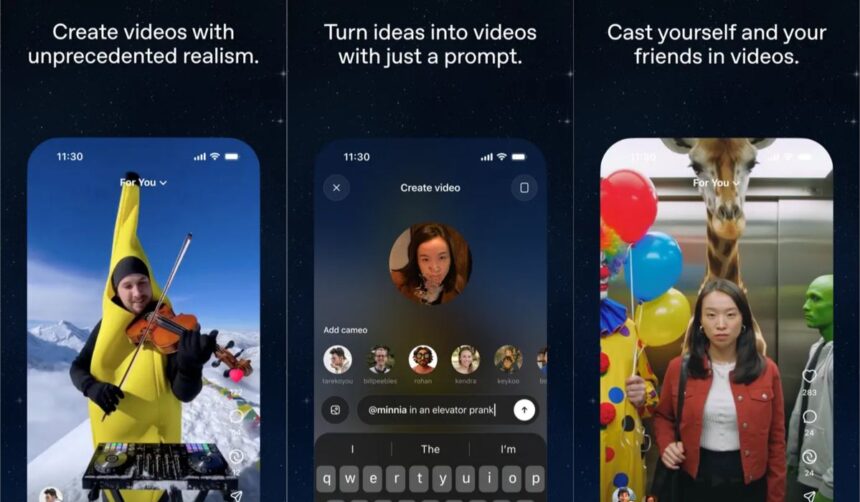

La nuova iterazione del software di OpenAI, Sora 2, ha fatto il suo ingresso sui dispositivi Android nel mercato nordamericano, registrando un successo travolgente. In soli cinque giorni, l’applicazione ha superato il milione di installazioni. Questo strumento, precedentemente accessibile solo su invito per iOS negli USA e in Canada, permette la creazione di brevi filmati iperrealistici, della durata di dieci secondi, partendo da semplici indicazioni testuali.

È sufficiente inserire una descrizione, come “un cane che corre a Central Park”, perché il sistema generi in pochi attimi una clip dall’aspetto cinematografico. La rapida diffusione dei video, facilitata dalla condivisione sui social media, ha immediatamente sollevato interrogativi profondi. Si discute animatamente sulla capacità del software di replicare fattezze, luoghi e persone, anche scomparse, aprendo un fronte complesso su etica, proprietà intellettuale e i confini dell’IA generativa.

Un salto qualitativo impressionante

Sora 2 rappresenta un evidente progresso tecnologico rispetto al modello precedente, che già aveva destato stupore. Oltre a una qualità visiva superiore, l’intelligenza artificiale ora sfrutta un sistema di comprensione del linguaggio naturale più raffinato.

È capace di emulare movimenti di macchina, gestire l’illuminazione e riprodurre le texture con una fedeltà sorprendente. I filmati prodotti sono spesso difficilmente distinguibili da quelli girati realmente e hanno rapidamente saturato le piattaforme social.

La stessa azienda, colta di sorpresa dalla popolarità improvvisa, ha riconosciuto di stare ancora cercando un punto di equilibrio tra la libertà espressiva e la tutela dei diritti dei soggetti raffigurati.

Responsabilità e future regolamentazioni

L’applicazione Sora 2 ha portato alla luce un altro tema delicato: a chi appartiene la responsabilità legale dei materiali prodotti? OpenAI sostiene che la piattaforma sia vigilata da un apparato di moderazione e da filtri per limitare usi impropri. I casi di deepfake dimostrano, però, che queste barriere potrebbero non essere sufficienti.

I modelli video, analogamente a quelli testuali, si addestrano su gigantesche moli di dati, rendendo complicato separare l’utilizzo legittimo dall’appropriazione indebita. Sam Altman ha comunicato che l’azienda implementerà un “controllo più granulare”. Questo sistema darebbe ai detentori dei diritti la facoltà di stabilire in modo specifico come, dove e da chi i loro personaggi o le loro opere protette possano essere impiegati.

Il CEO ha inoltre accennato alla futura attivazione di un meccanismo di condivisione dei profitti (revenue sharing). Questo sistema permetterebbe di redistribuire una quota dei guadagni a coloro che autorizzeranno l’impiego dei propri contenuti. Nel frattempo, la viralità di Sora 2 sta mettendo a dura prova l’infrastruttura tecnica di OpenAI, con server sovraccarichi e conseguenti rallentamenti nella generazione dei risultati.

Le nuove norme in Italia

Mentre Sora 2 si appresta a debuttare su Android anche al di fuori del Nord America (sebbene una data precisa non sia stata ancora fissata), l’Italia si muove per normare in generale il fenomeno della creazione di contenuti con l’intelligenza artificiale.

Dal 10 ottobre è infatti operativa una nuova legislazione sull’intelligenza artificiale. Questa legge introduce per la prima volta in assoluto il reato di deepfake. Chi diffonde registrazioni audio, video o immagini falsificate senza il consenso dell’interessato, arrecando un danno alla persona, rischia una pena detentiva da uno a cinque anni. La norma italiana, la prima di questo tipo nel contesto europeo, interviene per colmare un vuoto normativo.

Questo avviene in un’epoca in cui strumenti come Sora 2 rendono la creazione di video accessibile a chiunque. Il provvedimento è pensato per proteggere non soltanto la reputazione degli individui, ma anche la stessa creatività umana, messa in discussione da algoritmi sempre più sofisticati. Il rischio è che, entro pochi anni, diventi impossibile per l’occhio umano discernere un video creato artificialmente da uno autentico.